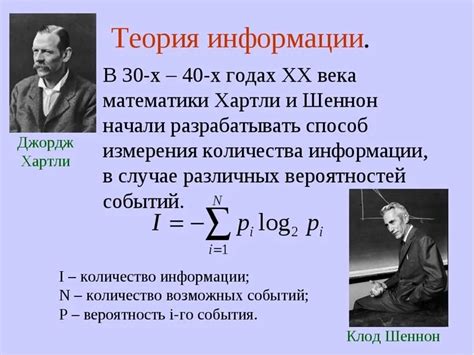

Теория информации - это область, которая изучает кодирование и передачу информации, а также оценку ее количественных характеристик. Она была развита Клодом Шенноном, американским математиком и инженером, в середине 20 века. Одной из важнейших концепций в этой области является понятие "шеннона", которое используется для измерения количества информации.

Шеннон предложил использовать биты для измерения информации. Бит (binary digit) является наименьшей единицей информации и может принимать только два значения - 0 или 1. Используя эту концепцию, можно определить количество информации в сообщении. Например, если мы знаем, что наше сообщение может принять только одно из двух значений, то для передачи этого сообщения нам понадобится 1 бит информации.

Но что если сообщение может принимать больше двух значений? Шеннон предложил использовать формулу "log2(n)", где "n" - количество возможных значений, которые может принимать сообщение. Например, если сообщение может принимать одно из восьми значений, то для передачи этого сообщения потребуется 3 бита информации.

Концепция шеннона нашла свое применение в различных областях, включая передачу данных, сжатие информации, криптографию и даже в психологии. Она позволяет оценить объем информации, определить оптимальные схемы кодирования и повысить эффективность информационных систем.

Шеннон - главный принцип информационной теории

Основная идея Шеннона заключается в том, что информация - это различия между двумя состояниями или событиями. Иными словами, существенная информация возникает, когда мы получаем новую информацию или узнаем что-то неожиданное или редкое.

Шеннон ввел понятие бита как единицы информации, которая может принимать два возможных значения – 0 или 1. Количество битов в сообщении определяет количество информации, которое несет это сообщение. Чем больше информации, тем больше битов требуется для ее передачи.

Принцип Шеннона имеет важное практическое применение в области связи и передачи данных. Он позволяет инженерам и ученым эффективно передавать информацию по телекоммуникационным системам, сжимать данные, улучшать качество связи и т.д.

Принцип Шеннона также применим в других областях, таких как статистика, криптография, компьютерные науки и т.д. Он является основополагающим принципом для понимания и измерения информации, что играет важную роль в широком круге научных и технических дисциплин.

История создания и важность

Концепция информации и её передачи стала объектом исследования и развития в середине XX века. Один из важнейших вкладов в эту область сделал американский математик Клод Шеннон.

В 1948 году Шеннон опубликовал свою работу "Математическая теория связи", в которой он представил новый подход к изучению информации и её передачи. Он разработал математическую модель и формулы, которые позволяли оценивать количество информации, передаваемой в сообщении, и определять её емкость.

Идеи Шеннона оказались революционными и получили широкое признание в научных кругах. Они стали основой для развития теории информации и телекомуникаций. Благодаря этим идеям возникли новые разделы науки, такие как компьютерная наука, криптография, сжатие данных и другие.

Принципы Шеннона также нашли применение в различных областях человеческой деятельности. В современном мире, где информация играет важнейшую роль, идеи Шеннона стали неотъемлемой частью таких сфер как интернет, телефония, радио и телевидение.

Важность концепции Шеннона заключается в том, что она позволяет эффективно передавать и обрабатывать информацию, сокращая избыточность и увеличивая скорость передачи. Она легла в основу множества технологий и методов, которые используются в современных сетях связи и информационных системах.

Определение основных понятий

Теория информации - область науки, которая изучает количественные характеристики информации. Она имеет своей целью определить, какая информация является полезной, как ее передавать и хранить с наименьшими потерями.

Кодирование - процесс преобразования информации из одной формы в другую для более эффективной передачи или хранения. В контексте теории информации кодирование позволяет уменьшить объем передаваемых или хранимых данных.

Теорема Шеннона - одна из основных теорем теории информации. Она устанавливает максимально возможную скорость передачи информации через канал связи с заданной пропускной способностью и уровнем шума.

Энтропия - понятие, описывающее меру неопределенности или информативности сообщения. Чем выше энтропия, тем больше неопределенность или информация содержится в сообщении.

Как использовать шенноновский код

Для использования шенноновского кода вам необходимо выполнить следующие шаги:

1. Определите вероятности появления каждого символа в вашем сообщении. Назначьте более вероятным символам более короткие коды.

2. Воспользуйтесь алгоритмом Шеннона-Фано для разделения символов на две группы. Разделение основывается на вероятностях появления символов.

3. Присвойте коды каждому символу в каждой группе. Более вероятные символы должны иметь более короткие коды, а менее вероятные символы - более длинные коды.

4. Закодируйте ваше сообщение, заменяя каждый символ кодом, полученным на предыдущем шаге.

При использовании шенноновского кода важно учитывать, что эффективность кодирования зависит от вероятностей появления символов в сообщении. Чем более равномерны вероятности, тем более эффективное кодирование вы получите.

Применение в цифровых системах связи

Использование теории информации позволяет получить максимальную скорость передачи данных при заданном уровне шума и ограничениях канала. Для достижения максимальной пропускной способности канала необходимо использование эффективных методов кодирования и сжатия данных.

Также теория информации является основой для разработки различных кодирований, таких как кодирование Хэмминга и кодирование паритетными битами. Эти методы позволяют обнаруживать и исправлять ошибки передачи данных, что повышает надежность связи.

Другим применением теории информации в цифровых системах связи является определение энтропии и избыточности информации. Избыточность информации позволяет устранить неопределенности в передаче данных и повысить их надежность.

В целом, применение теории информации в цифровых системах связи позволяет эффективно передавать данные, обеспечивать их надежность и оптимальность при заданных ограничениях канала связи.

Примеры использования в современном мире

Теория информации, разработанная Клодом Шенноном, играет важную роль во многих аспектах современной жизни. Вот некоторые примеры использования этой теории:

1. Коммуникация и связь: Теория информации используется для определения возможности передачи и приема информации в телекоммуникационных системах. Она помогает определить, какие каналы связи наиболее эффективны и надежны для передачи информации.

2. Сжатие данных: Шенноновская теория информации широко применяется при разработке алгоритмов сжатия данных. Она позволяет удалять избыточность из информации, что позволяет сократить объем передаваемых данных и улучшить скорость передачи.

3. Криптография: Концепции из теории информации используются в криптографии для обеспечения безопасности информации. Они помогают разработать эффективные алгоритмы шифрования, которые защищают данные от несанкционированного доступа.

4. Исследование рынка и прибыльность инвестиций: Теория информации используется для анализа данных рынка и оценки прибыльности инвестиций. Она помогает определить, какая информация является значимой и как использовать ее для принятия решений.

5. Информационный поиск и рекомендательные системы: Алгоритмы, основанные на теории информации, используются в информационном поиске и рекомендательных системах. Они позволяют эффективно обрабатывать и классифицировать информацию, а также предлагать релевантные рекомендации пользователю.

6. Машинное обучение и искусственный интеллект: Теория информации имеет широкое применение в области машинного обучения и искусственного интеллекта. Она помогает разработать алгоритмы, которые могут эффективно обрабатывать и анализировать большие объемы данных.

Все эти примеры демонстрируют, как теория информации Клода Шеннона оказывает значительное влияние на современный мир, вокруг нас зависит от эффективной передачи, обработки и анализа информации.